Som una Fundació que exercim el periodisme en obert, sense murs de pagament. Però no ho podem fer sols, com expliquem en aquest editorial.

Clica aquí i ajuda'ns!

En les darreres setmanes, hem vist vídeos creats per intel·ligència artificial per desacreditar rivals polítics. Però aquesta tecnologia no serveix només per alimentar els rumors i la propaganda. Tot depèn del prisma per on es miri: també pot ser una aliada en la lluita contra la desinformació.

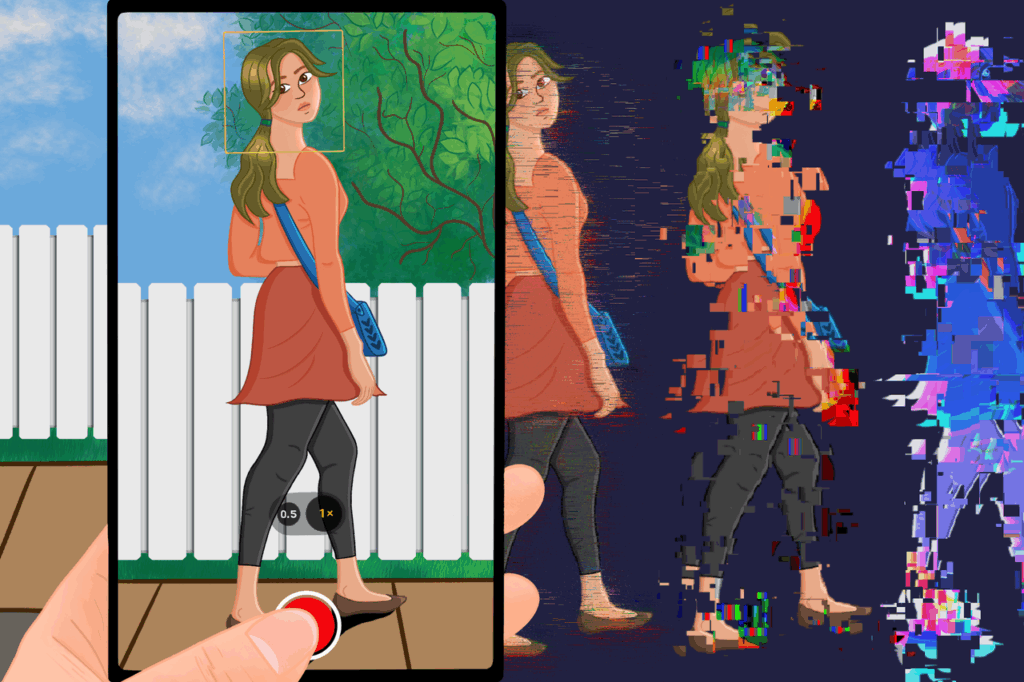

Un deepfake és un contingut audiovisual alterat mitjançant IA ( deep learning ). El més popular és canviar l’expressió facial d’algú. Altres vegades es barregen els trets de dues persones.

Els primers van aparèixer el 2019, encara que el seu apogeu va arribar durant la pandèmia de covid-19.

En 2021, un compte de TikTok va publicar diversos vídeos de Tom Cruise. On ha après Tom Cruise a fer màgia? Des de quan sap tocar la guitarra? En realitat, eren enregistraments fets a un doble de l’actor. Els vídeos, que van representar un salt de qualitat en aquesta mena de produccions, es van editar amb programes informàtics i algorismes d’intel·ligència artificial.

En campanya electoral

El 2024, després d’analitzar la presència de deepfakes en processos electorals, un estudi va concloure que molts són difosos per l’entorn polític. L’objectiu pot ser promocionar una campanya o desacreditar el rival. Aquesta tendència ha arribat recentment a Espanya.

Alguns vídeos han estat eliminats davant de les protestes, ja que, a més, poden perjudicar la imatge pública de tercers.

La polèmica sorgeix també en justificar-ne l’ús. Aquest tipus de tecnologies permet que la comunicació “evolucioni”? Les campanyes de publicitat amb deepfakes són “més eficaces”?

Afecten la confiança als mitjans?

Un estudi publicat el 2025 aborda aquesta qüestió, centrant-se en l’impacte dels deepfakes a la credibilitat dels mitjans. Segons els autors, aquesta pràctica provoca una pèrdua de confiança al mitjà de comunicació, tal com van constatar els participants després de ser informats de l’engany.

D’altra banda, apunta que no és clar si estar exposats a aquests continguts afecta la nostra capacitat per diferenciar entre una imatge real i una falsa. Així mateix, els autors no van poder trobar quins factors fan a un format deepfake més o menys creïble. De fet, no sembla que aquests vídeos decebin més l’audiència que una notícia falsa escrita a la manera tradicional.

La comunitat científica ha proposat usar la IA per lluitar contra la desinformació.

El processament del llenguatge natural, que estudia les expressions que apareixen als textos, és eficaç per detectar inconsistències en notícies falses.

A més, l’aprenentatge automàtic, que analitza grans volums de text per fer prediccions, pot ajudar a destriar entre informacions reals i falsedats.

Una altra eina és l’anàlisi de sentiments, que avalua el to o emoció d’un text i és útil per cercar contingut polaritzat a les xarxes socials.

Avantatges i desavantatges

Aquestes tècniques tenen avantatges davant dels moderadors de contingut humans. La primera és que la intel·ligència artificial analitza molta més informació. A més, ho fa de manera automàtica en molt menys temps.

Un altre avantatge és la immediatesa: podem detectar en temps real tendències i temàtiques que sorgeixen a les xarxes socials. Això ajuda a intervenir més ràpidament.

Tot i això, les eines d’IA també tenen limitacions. Manquen de context per entendre expressions de llenguatge complexes. No saben interpretar dobles sentits.

Un inconvenient més és que estan esbiaixades per la informació verídica i falsa amb què han estat entrenats. A més, no són transparents en les decisions a l’hora de determinar si una notícia és falsa o no.

Regulació europea

La regulació europea exigeix identificar un contingut audiovisual generat per intel·ligència artificial. Aquestes normatives poden persuadir personalitats públiques, mitjans de comunicació o empreses, quan el que està en joc és preservar-ne la reputació.

D’altra banda, la mateixa tecnologia que genera els deepfakes pot ajudar a detectar-los. Després de processar grans quantitats d’exemples, la IA aprèn a trobar característiques que distingeixin continguts falsos i reals.

Ara com ara, però, la generació de deepfakes està molt més avançada que la detecció. Si la qualitat de la imatge és baixa, els detectors tenen problemes per analitzar-la. A això se suma que encara donen força “falsos positius”, és a dir, cataloguen moltes vegades com a deepfake un contingut que no ho és.

Mentrestant, el que és clar és que la generació de contingut amb intel·ligència artificial continuarà en augment. La precisió de les cares, els moviments humans i les veus continuarà perfeccionant-se.

Però la batalla no hi és. La clau és fer un ús responsable i ètic de la intel·ligència artificial.

Aquesta informació ha estat publicada per l’Agència Sinc.